Αντιπρόσωποι της Κομισιόν, του Ευρωπαϊκού Κοινοβουλίου και των 27 χωρών μελών κατέληξαν μετά από εντατικές διαπραγματεύσεις σε μια συμφωνία για τη διαμόρφωση ενός ρυθμιστικού πλαισίου ανάπτυξης και χρήσης των τεχνολογιών τεχνητής νοημοσύνης.

Οι εμπλεκόμενες πλευρές για να καταλήξουν σε συμφωνία ξεπέρασαν μεγάλες διαφορές και μια σειρά από «αγκάθια» σχετικά με τη γενική τεχνητή νοημοσύνη και την χρήση της για την επιτήρηση πολιτών και την παραβίαση προσωπικών δεδομένων και ελευθεριών.

Έτσι η ΕΕ «γίνεται η πρώτη που ορίζει σαφείς κανόνες για τη τεχνητή νοημοσύνη», υπογράμμισε με ικανοποίηση ο ευρωπαίος επίτροπος Τιερί Μπρετόν, ο οποίος είχε παρουσιάσει το αρχικό σχέδιο τον Απρίλιο του 2021.

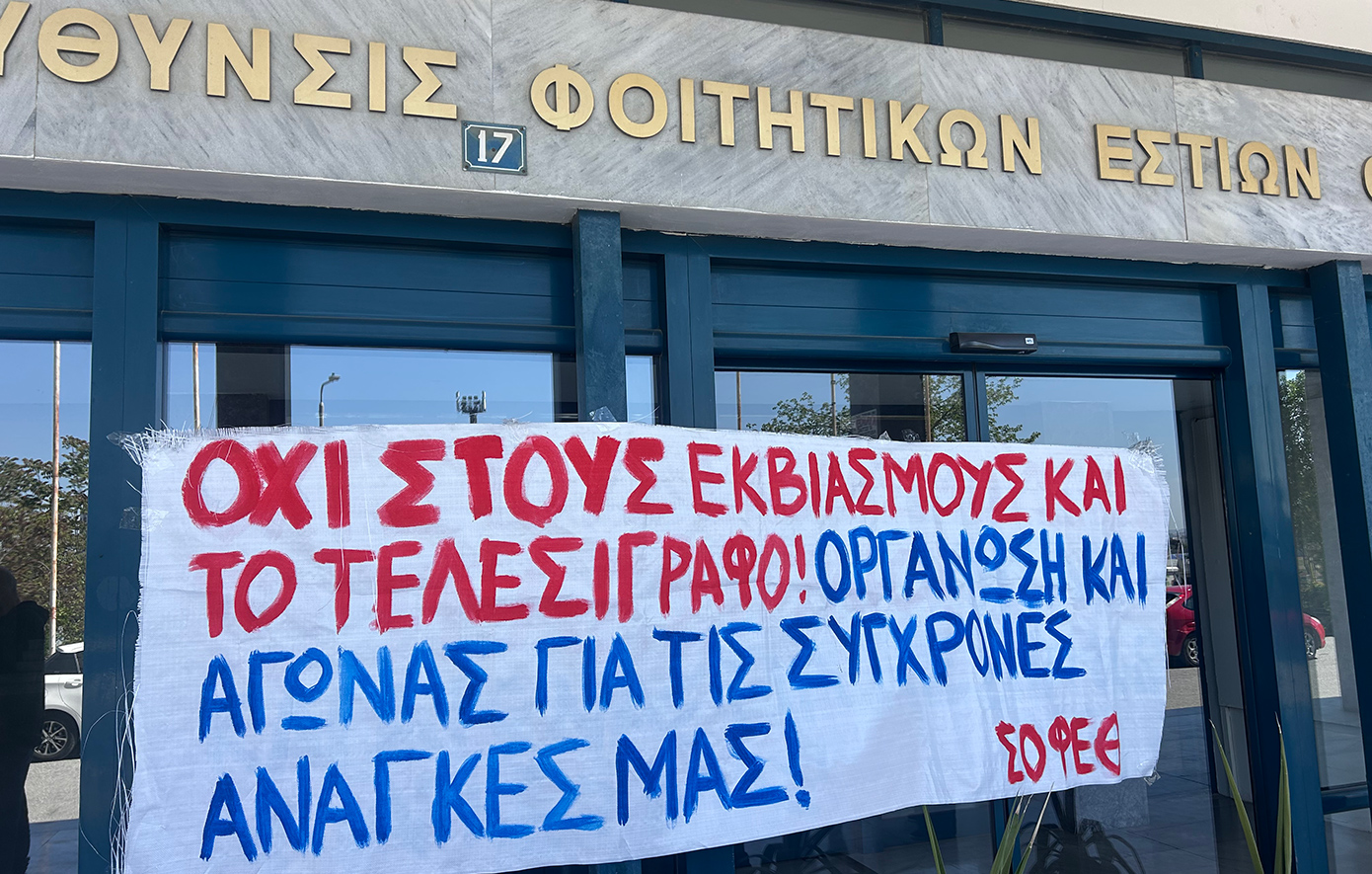

Επιφυλάξεις από ακτιβιστές και λομπίστες

Οργανώσεις και ομάδες της κοινωνίας των πολιτών, που εστιάζουν στους κινδύνους της τεχνητής νοημοσύνης, εμφανίζονται επιφυλακτικές για τις εξελίξεις και δεν συμμερίζονται – προς ώρας – τον ενθουσιασμό των αξιωματούχων.

Υπογραμμίζουν πως η συμφωνία δεν φαίνεται να έχει κάνει σημαντική πρόοδο για την προστασία των ανθρώπων από τους κινδύνους της τεχνητής νοημοσύνης. Για τον λόγο αυτό επισημαίνουν θα περιμένουν τη διευθέτηση των τεχνικών λεπτομέρειών της συμφωνίας, καθώς, έχει αποδειχθεί πολλές φορές στο παρελθόν, «ο διάβολος κρύβεται στις λεπτομέρειες».

«Η πολιτική συμφωνία σηματοδοτεί την έναρξη των σημαντικών και αναγκαίων τεχνικών εργασιών για τη διευθέτηση κρίσιμων λεπτομερειών ενός νόμου για την τεχνητή νοημοσύνη, οι οποίες εξακολουθούν να λείπουν», δήλωσε, σύμφωνα με το Time, ο Ντάνιελ Φριντλάνντερ, επικεφαλής του ευρωπαϊκού γραφείου της «Computer and Communications Industry Association», μιας ομάδας του λόμπι της βιομηχανίας τεχνολογίας.

Το πρότυπο της ΕΕ

Πρωτοστατώντας, η ΕΕ παρουσίασε το αρχικό σχέδιο τον Απρίλιο του 2021, όμως εμφάνιση του ChatGPT και οι ραγδαίες εξελίξεις στον χώρο της τεχνητής νοημοσύνης που πυροδοτήθηκαν από τον ανταγωνισμό των τεχνολογικών κολοσσών, δημιούργησαν νέα δεδομένα, αποκάλυψαν κινδύνους και δυνατότητες της νέας τεχνολογίας και επιμήκυναν τις συνομιλίες. Ο τελευταίος γύρος διαπραγματεύσεων ξεκίνησε την περασμένη Τετάρτη και ολοκληρώθηκε με «λευκό καπνό» την Παρασκευή.

Ο νόμος, που δεν αναμένεται να τεθεί πλήρως σε ισχύ πριν από το 2025, προβλέπει αυστηρές οικονομικές κυρώσεις για παραβιάσεις έως και 35 εκατομμυρίων ευρώ ή 7% του τζίρου μιας εταιρείας. Τη σκυτάλη από την ΕΕ για τη διαμόρφωση ενός ρυθμιστικού πλαισίου χρήσης της τεχνητής νοημοσύνης αναμένεται να πάρουν οι ΗΠΑ, το Ηνωμένο Βασίλειο, η Κίνα, αλλά και διεθνείς συνασπισμοί, όπως για παράδειγμα η G7.

Οι κανόνες της ΕΕ «μπορούν να αποτελέσουν ισχυρό παράδειγμα για πολλές κυβερνήσεις που εξετάζουν το ενδεχόμενο ρύθμισης», δήλωσε η Άνου Μπράντφορντ, καθηγήτρια Νομικής Σχολής της Κολούμπια, ειδικός στο δίκαιο της ΕΕ και τις ψηφιακές ρυθμίσεις. Άλλες χώρες «δεν χρειάζεται να αντιγράψουν κάθε διάταξη, αλλά πιθανότατα θα μιμηθούν πολλές πτυχές», ανέφερε στο Time.

Οι ανησυχίες

Πάντως κράτη μέλη της ΕΕ έχουν εκφράσει φόβους για το ενδεχόμενο μια «υπερβολική κανονιστική ρύθμιση» να σκοτώσει εν τη γενέσει τους τις ευρωπαϊκές εταιρείες που αναπτύσσουν τεχνητή νοημοσύνη. Οι εταιρείες τεχνητής νοημοσύνης που υπόκεινται στους κανόνες της ΕΕ θα μπορούσαν να επεκτείνουν ορισμένες από τις δράσεις τους εκτός της ηπείρου, εκτίμησε και η Άνου Μπράντφορντ.

«Θα αναλύσουμε προσεκτικά το συμβιβασμό που επιτεύχθηκε σήμερα και θα εξασφαλίσουμε μέσα στις επόμενες εβδομάδες ότι το κείμενο προστατεύει τη δυνατότητα της Ευρώπης να αναπτύξει τις δικές της τεχνολογίες τεχνητής νοημοσύνης και να προστατεύσει τη στρατηγική αυτονομία της», υπογράμμισε ο Γάλλος υπουργός Ψηφιακής Διακυβέρνησης Ζαν-Νοέλ Μπαρό.

Ο επικεφαλής του τομέα των Ευρωπαϊκών Υποθέσεων της IBM, Ζαν Μαρκ Λεκλέρκ, επικροτώντας την επίτευξη «προσωρινής συμφωνίας», ανέφερε πως «έχουμε παροτρύνει επί μακρόν την ΕΕ να υιοθετήσει μια προσεκτικά ισορροπημένη προσέγγιση, εστιάζοντας στη ρύθμιση των εφαρμογών τεχνητής νοημοσύνης υψηλού κινδύνου, προωθώντας παράλληλα τη διαφάνεια, την επεξήγηση και την ασφάλεια όλων των μοντέλων τεχνητής νοημοσύνης».

Και πρόσθεσε: «Καθώς οι νομοθέτες επεξεργάζονται τις υπόλοιπες τεχνικές λεπτομέρειες, ενθαρρύνουμε τους υπεύθυνους χάραξης πολιτικής της ΕΕ να διατηρήσουν την εστίασή τους στον κίνδυνο και στη λογοδοσία, και όχι στους αλγόριθμους. Μοιραζόμαστε τους στόχους σε ότι αφορά την ασφάλεια και την αξιόπιστη ανάπτυξη της τεχνητής νοημοσύνης καθώς και τη δημιουργία ενός ανοικτού οικοσυστήματος τεχνητής νοημοσύνης υπέρ της καινοτομίας, και αναγνωρίζουμε ότι τόσο η κυβέρνηση όσο και ο κλάδος διαδραματίζουν καίριο ρόλο στην επίτευξή τους».

Κάποια βασικά σημεία της συμφωνίας

Σχετικά με τη γενική τεχνητή νοημοσύνη, ο συμβιβασμός προβλέπει μια προσέγγιση δύο ταχυτήτων. Κανόνες επιβάλλονται σε όλους για να εξασφαλισθεί η ποιότητα των δεδομένων που χρησιμοποιούνται για την εκπόνηση αλγορίθμων και για να ελεγχθεί πως δεν παραβιάζουν τη νομοθεσία περί των δικαιωμάτων του δημιουργού. Αυτοί που αναπτύσσουν συστήματα τεχνητής νοημοσύνης θα πρέπει εξάλλου να εξασφαλίζουν ότι οι ήχοι, οι εικόνες και τα κείμενα που παράγονται θα αναφέρεται ξεκάθαρα ότι είναι τεχνητά. Ενισχυμένες υποχρεώσεις θα ισχύουν μόνο για τα πιο ισχυρά συστήματα.

Το κείμενο επικαλείται τις αρχές των υφιστάμενων ευρωπαϊκών κανονισμών στο θέμα της ασφάλειας των προϊόντων, οι οποίες επιβάλλουν ελέγχους που αφορούν πρώτα τις επιχειρήσεις. Η καρδιά του σχεδίου έγκειται σε ένα κατάλογο κανόνων οι οποίοι επιβάλλονται μόνο στα συστήματα που χαρακτηρίζονται «υψηλού κινδύνου», κυρίως αυτά που χρησιμοποιούνται σε ευαίσθητους τομείς όπως οι κρίσιμης σημασίας υποδομές, η εκπαίδευση, οι ανθρώπινοι πόροι, η διατήρηση της τάξης…

Τα συστήματα αυτά θα υπόκεινται σε μια σειρά υποχρεώσεων, όπως να υπάρχει ανθρώπινος έλεγχος της μηχανής ή ακόμη να είναι εγκατεστημένο ένα σύστημα διαχείρισης κινδύνου. Η νομοθεσία προβλέπει ιδιαίτερη πλαισίωση των συστημάτων της τεχνητής νοημοσύνης που αλληλεπιδρούν με ανθρώπους. Θα τα υποχρεώνει να ενημερώνουν το χρήστη ότι βρίσκεται σε επαφή με μια μηχανή.

Οι απαγορεύσεις θα είναι σπάνιες. Θα αφορούν τις εφαρμογές που είναι αντίθετες στις ευρωπαϊκές αξίες, όπως τα συστήαμτα μαζικής παρακολούθησης που χρησιμοποιούνται στην Κίνα, ή ακόμη τα συστήματα βιομετρικής αναγνώρισης εξ αποστάσεως προσώπων σε δημόσιους χώρους ώστε να αποφευχθεί η μαζική παρακολούθηση πληθυσμών.

Σ’ αυτό το τελευταίο σημείο τα κράτη έλαβαν πάντως εξαιρέσεις για ορισμένες αποστολές των δυνάμεων της τάξης, όπως η μάχη εναντίον της τρομοκρατίας. Αντίθετα από τους εθελοντικούς κώδικες συμπεριφοράς ορισμένων χωρών, η ευρωπαϊκή νομοθεσία θα εφοδιασθεί με μέσα επιτήρησης και κυρώσεων με τη δημιουργία ενός ευρωπαϊκού γραφείου τεχνητής νοημοσύνης στους κόλπους της Ευρωπαϊκής Επιτροπής. Θα μπορεί να επιβάλλει πρόστιμα έως το 7% του τζίρου, με οροφή τα 35 εκατομμύρια ευρώ για τις πιο σοβαρές παραβάσεις.